近日,我院青年博士陈燚雷在《电子学报》发表论文《基于语义增强与纹理-运动融合的说话人无关视觉配音方法》。

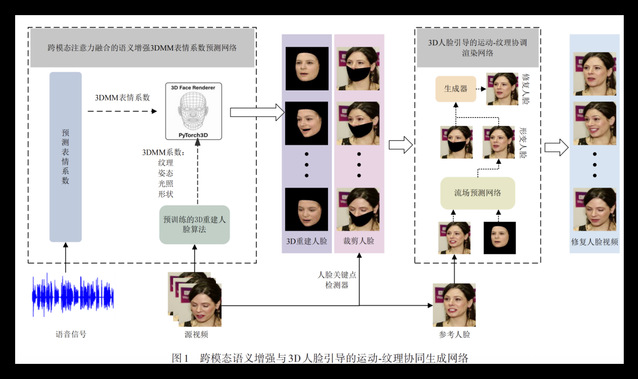

研究围绕真实场景视觉配音难题,提出以“运动-纹理协同融合”驱动的高保真生成框架,为复杂头动条件下的自然口型合成带来新突破。团队指出,传统视觉配音在头部转动、侧脸或遮挡时易产生唇周纹理模糊与修复不连续的“补丁感”。为此,论文引入3D可变形人脸模型作为中间表示,将任务分为“语音驱动三维表情运动预测”和“运动引导纹理生成渲染”两阶段:先让人脸运动精准可控,再用运动信息反向约束纹理补偿,从源头提升几何一致性与纹理真实度。研究的核心创新在运动与纹理的联合建模,渲染阶段通过语义引导的运动流场实现全局非刚性对齐,确保跨姿态下“动得对”;随后运动感知纹理调制模块在流场约束下调制多尺度纹理特征,把运动结构直接转化为纹理生成先验,稳定恢复嘴唇与唇周高频细节;再结合多参考纹理与自适应融合,兼顾全局运动一致与局部细节自然过渡。实验表明,该策略显著提升纹理清晰度与稳定性,并在VoxCeleb1/2等数据集上全面优于现有方法。

该工作展示了“运动融合促进纹理生成”的有效路径,为虚拟人、影视配音、本地化传播与在线教育等应用提供了更可靠的技术支撑,并有望在数字金融领域的智能客服、虚拟柜员与沉浸式业务宣介中发挥赋能作用。(撰稿:陈燚雷 审核:李睿恒)